线性代数的本质

线性代数的本质

pcfx写在前面:

这学期我们开了一门线性代数的课程,买了一本《线性代数及其应用》读了一半,有收获,但是感觉还是迷迷糊糊的。

看了3Blue1Brown视频,对线性代数有了更加直观的认识,从对原先对计算的直观认识,转换对空间变换的认识。

我看的是up婆婆町的UP主汉语配音-【线性代数的本质】版本。

内容若有错误,敬请斧正!

1.什么是向量

有以下不同观点:

- 物理:空间中的箭头

- 计算机:有序的数字列表

- 数学:任何东西只要相加相乘符合向量的定义

我们在几何上,把向量拆分为起点(原点)和坐标,如$ \begin{pmatrix}-3\\1 \end{pmatrix}$ 或$ \begin{pmatrix}2\\1\\3 \end{pmatrix}$

在这里我们给出向量的几种运算:

- 向量加法:平移,首尾相接

- 向量数乘:拉长(缩放)

2.张成的空间与基

我们通常使用\(\vec i\) \(\vec j\) \(\vec k\) 表示\(x,y,z\)方向上的单位向量。

如 $ \begin{pmatrix}3\\-2 \end{pmatrix}=3\vec i-2\vec j$

对于向量的数字描述,依赖于我们所使用的基底。

什么是线性?linear

“张成”表示通过线性组合产生所有可能结果。对两个向量进行数乘和加法可张成:

- 一个面

- 一条线(共线)

- 一个定点(两个都为“0向量”)

同理 对于两个三位向量 我们能张成一个平面。

若新加一个三维向量:

- 若在该平面内,张成空间仍为平面

- 若不在,张成整个三维空间。

一组向量中至少有一个是多余的,没有对张成空间做成贡献或者说 其中一个向量能被其他向量的线性组合所表示 称为线性相关。

如果每一个向量都新增了新的维度 则称为线性无关。

或者说 当且仅当 \(a=b=c=0\) 时,\(a\vec v+b\vec w+c\vec u =\vec 0\) 成立,则称向量组\(\{\vec a,\vec b,\vec c\}\)是线性无关的。

3.矩阵与线性变换

线性变换是一个接受向量并输出向量的函数,满足:

- 直线在变化后依然是直线

- 原点位置不动

即保持网格平行并等距分布的变换。

要描述二维线性变换,只需说明单位向量的变化:

如我们要将\(\vec v = -1\vec i+2\vec j\) 做线性变换

那么 \(\vec v_{Transformed}=-1\vec i_{Transformed}+2\vec j_{Transformed}\) 意味着我们只需要知道基向量的变化,我们就能推导出任意向量的变化。

假设经过线性变换后,基向量的变化情况如下:\(\vec {\imath} \rightarrow \begin{bmatrix} 1 \\\\ -2 \end{bmatrix} \quad\quad \vec {\jmath} \rightarrow \begin{bmatrix} 3 \\\\ 0 \end{bmatrix}\)

那么某一向量经过线性变换如下\(\begin{bmatrix} x \\\\ y \end{bmatrix} \rightarrow x \begin{bmatrix} 1 \\\\ -2 \end{bmatrix} + y \begin{bmatrix} 3 \\\\ 0 \end{bmatrix} = \begin{bmatrix} {1}x + {3}y \\\\ {-2}x + {0}y \end{bmatrix}\)

如此,我们能规定许多线性变化,如:

逆时针旋转90°:\(\begin{bmatrix} 0 &-1\\\\1&0 \end{bmatrix}\)

剪切:\(\begin{bmatrix} 1&1\\\\0&1 \end{bmatrix}\)

总而言之,矩阵,我们可以理解成为空间上的一种变换。

4.矩阵乘法与线性变换的复合联系

矩阵乘法=线性变换的组合。

而矩阵相乘,就是将变换应用于某个向量。

如果我们要先旋转90°再执行剪切,那么这就是一个复合的线性变换。

先将向量旋转再剪切:[剪切矩阵]([旋转矩阵] [向量]) 和执行复合矩阵:([剪切矩阵] [旋转矩阵])[向量] 二者是等价的。

所以两个矩阵相乘具有几何意义,也就是两个线性变换相继作用,需要从右向左读。

所以对于矩阵乘法的结合律 $A(BC)=(AC)C $的等价,我们有了一个更加直观的认识。

5.行列式

二维中:

行列式的值=面积变化的比例

正负:空间的定向(反转)

三维中:

行列式的值=体积缩放的比例

正负:符合右手定则为正,否则为负

所以我们对\(det(\begin{bmatrix} a&0\\\\0&b \end{bmatrix})=ab\) 能有更加深刻的理解,相当于原先\(\begin{bmatrix} 1&0\\\\0&1 \end{bmatrix}\) 面积为1的单位面积,长扩大为\(a\)倍,宽扩大为\(b\)倍,所以面积扩大为 \(ab\) 倍。

如果是一个上下三角,则会变成一个平行四边形,我们使用 底×高 面积同样也是\(ab\)。

通过这图,我们能清晰的知道二维行列式的\(ad-bc\)是怎么得出来的。

当行列式结果为0,我们知道,此时面积(体积)被压缩为0面积(0体积),此时是一个高维转向低维的变换,此时这个矩阵的列必然线性相关。

\(det(M_1M_2)=det(M_1)det(M_2)\)我们能有一个更加深刻的理解。

单位面积(体积)通过\(M_1M_2\)复合变换 变换后的面积 和分别执行\(M_1M_2\)线性变换 变换后的面积是相等的,如此,我们能清晰的了解这一公式。

6.逆矩阵,列空间,秩与零空间

矩阵的作用:求特定方程组 这些未知量只进行加和 只有常数项 没有幂次 我们能转化为一个线性方程组。

我们可以看成 我们在寻找一个向量 \(\vec x\) 在经过线性变换 \(A\) 后,与向量 \(\vec v\) 重叠。

在二维中,\(A\)的变化分为两种

- 保持空间为二维 \(det(A)= C(C \ne0)\)

- 将空间挤压到更低维度 \(det(A)= 0\)

逆矩阵

如果保持空间为二维(不降维度)我们能通过一个逆变换(函数) 让 \(\vec v\) 变换为 \(\vec x\)

即 \(A\vec x =\vec v \Rightarrow \vec x = A^{-1}\vec v\)

\(A^{-1}\) 是\(A\)的逆(变换)可以理解为反函数

为什么当\(det(A)=0\)时 \(A^{-1}\)不存在?

我们就要回归到反函数存在的定义:

可逆的充分必要条件是该函数为双射,即同时为单射和满射。

也就是一一对应,如果出现多对一,反函数则会出现一对多,即一个函数值对映多个结果,这便不是映射。

\(det(A)=0\)时,空间从高维空间像低维空间压缩,一个低维向量对于许多高维向量。

也就是出现多对一,即不是单射,反函数会将一个变量对应多个输出,这不符合函数映射的定义。

\(A^{-1}A=E\) (恒等变换) 部分教材写作 \(I\)

秩

当变换的结果为1维 我们称这个变换的秩为1。

当变换的结果为2维 我们称这个变换的秩为2。

秩为变换后的维数。

所有可能的输出向量 \(A\vec v\) 构成的集合 都被成为矩阵的”列空间“,所谓列空间,就是矩阵的列所张成的空间。

所以更加精确的秩的定义是列的维数!

秩达到最大(秩与列数相等) => 满秩

- 满秩:只有原点落在原点上

- 非满秩:一条线/一个面 经过变换后落在原点

零空间

变换后落在原点的向量的集合,我们称为矩阵的”零空间“或”核“

附注:

非方阵问题(不同维度空间之间的线性变换)

也是 输入 → 输出 的一个过程 同样也有变换后基向量 这一表示方法。

如 \(3\times 2\) 的矩阵,就是把二维空间映射到三维,而这个矩阵的两列,分别代表\(\vec i ,\vec j\) 变换后的坐标,

而 \(2\times3\) 的矩阵,也就是将三维空间压缩到二维空间的变换。

而在这种变换下,线性变换的含义即为:

一条直线上一系列等距分布的点,在经过映射(变换)后,依旧等距分布。

7.点积与对偶性

标准观点:求点积就是将相应坐标配对,求每一对的成绩,并把结果相加。

几何解释:求一个向量对另外一个向量的投影,然后长度相乘 ( \(a\cdot b = |a||b|\cos \theta\) )。

为什么和投影有关?问题来自对偶性

在高维空间中,执行线性变换,要压缩到一维空间(数轴)。这和我们向量点积很相似。

\(1\times2\) 矩阵和 \(2\)维向量之间 有着微妙的关系 ,将向量放倒,就能得到与之相对应的矩阵。

我们考虑一个二维单位向量\(\vec u\) ,我们需要把二维的向量投影到这一条直线上,这个投影矩阵为\(\begin{bmatrix}\vec i_{Transform} &\vec j_{Transform}\end{bmatrix}\)

我们发现,\(\vec i_{Transform}\) 的值就是\(\vec i\)向\(\vec u\)投影的值,而这个值和 \(\vec u\) 向 \(\vec i\) 投影的值相等,\(\vec i_{Transform}\)也就是\(\vec u\)的横坐标。\(j_{Transform}\)同理。

所以这个投影矩阵相当于\(\begin{bmatrix} u_{x} &u_{y}\end{bmatrix}\) ,也就是\(\vec u\)的向量。

所以一个向量与这个矩阵相乘和与这个单位向量点积,他们的结果是一样的。

所以一个向量与单位向量的点积,能解读为,将这个向量投影到单位向量所得到的投影的长度。

而对于非单位向量,我们能通过数乘来进行转化。

所以我们可以把点积的向量,看作是一种线性变换的物质载体。

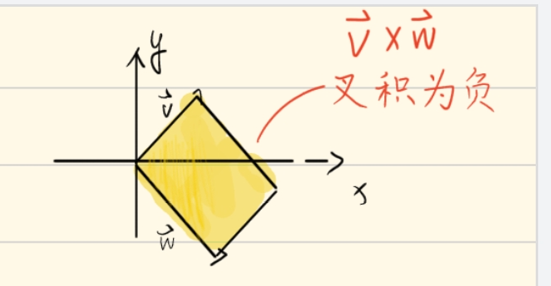

8.1叉积的标准介绍

以二维空间为例 \(|\vec v \times \vec w|= 平行四边形的面积\),

\(\vec v\) 在\(\vec w\) 的右侧,则\(\vec v \times \vec w\) 为正,

\(\vec v\) 在\(\vec w\) 的左侧,则\(\vec v \times \vec w\) 为负。

所以顺序对叉积有影响

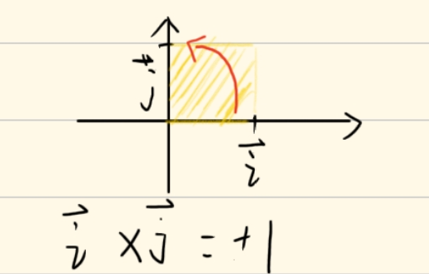

按序求两个基向量的叉积,结果为正,可以按这点来记忆。

\(\vec v \times \vec w = det([\vec v \space \vec w ])\)

为什么能这样写?我们可以这样理解,\(\vec i\) 经过线性变换后变成了\(\vec v\) ,同理\(\vec j\) 经过线性变换后变成了\(\vec w\)

所以$ det([\vec v \space \vec w ])$ 就是经过这个变换后,原先面积为\(1\times1\)单位面积的变换比例,也就是这个平行四边形的面积。

而由于经过了反转,所以面积变成为负值。

写成行也行,转置不影响行列式的值

三维空间:

通过两个三维向量形成一个新的三维向量,

这个新的三维向量长度也是平行四边形的面积,

方向垂直于这个平行四边形(右手定则)。

\(\begin{bmatrix} v_1 \\\\ v_2 \\\\ v_3 \end{bmatrix} \times \begin{bmatrix} w_1 \\\\ w_2 \\\\ w_3 \end{bmatrix} = \det\left( \begin{bmatrix} \hat{\imath} & v_1 & w_1 \\\\ \hat{\jmath} & v_2 & w_2 \\\\ \hat{k} & v_3 & w_3 \end{bmatrix} \right)\)

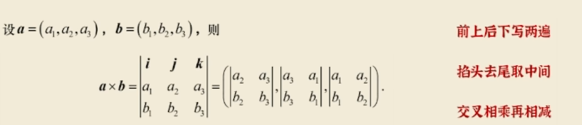

在同济高数教材中,我们会如下写

\(\begin{bmatrix} v_1 \\\\ v_2 \\\\ v_3 \end{bmatrix} \times \begin{bmatrix} w_1 \\\\ w_2 \\\\ w_3 \end{bmatrix} = \det\left( \begin{bmatrix} \hat{\imath} & \hat{\jmath} & \hat{k} \\\\ v_1 & v_2 & v_3 \\\\ w_1 & w_2 & w_3 \end{bmatrix} \right)\)

两种方法没有差异,转置不影响行列式的值

在计算的时候,我们要注意,这个代数余子式要有正负号

要是不想考虑这一点,可以用那个重复写,然后计算的方法可以看这个视频期末冲刺上大分 (一高数)

8.2 以线性变换的眼光看叉积

\(\vec v \times \vec w =\vec p\)

\(\vec p\)的性质

- 长度等\(\vec v\)和\(\vec w\)所确定的平行四边形面积

- 方向与\(\vec v\)和\(\vec w\)垂直

- 满足右手定则

对如输入的函数x,y,z我们能确定一个平行六面体,并得到体积

\(f(x,y,z)\)是线性的,我们将行列式展开,得到\(C_1x+C_2y+C_3z\) 故相距各点,扩大倍数后,相距比例保持一致,原点不动,所以是线性的

这个常数是\(\vec v\)和\(\vec w\)的线性组合

所以这个与\(\vec p\)点积, 相当这个函数,通过接受(x,y,z)并得出这个平行六面体的体积。

根据点积的定义,这个点积的大小就等于我们把(x,y,z)投影到\(\vec p\) 然后和其的模长相乘,

所以投影到p的长度,我们可以理解为这个平行六面体的高,对应\(\vec v\)和\(\vec w\)这个平行四边形的底,

所以\(\vec p\) 是一个向量,是\(\vec v\)和\(\vec w\)所成平行四边形的高,所以与\(\vec v\)和\(\vec w\)垂直,且模长和这个平行四边形底的面积相同。

9.基变换

坐标可以看成是缩放基向量的标量

不同的基底表示同一个向量的语言(坐标)不同

用矩阵向量的乘法可用于线性变换,来切换不同的基底。

比如说我们要用\(\begin{bmatrix} 0 \\\\1 \end{bmatrix}\) 和\(\begin{bmatrix} -1 \\\\0 \end{bmatrix}\)作为基向量表示\(\begin{bmatrix} x \\\\y \end{bmatrix}\)

在这个基下, \(\begin{bmatrix} x \\\\y \end{bmatrix}\) 的表示方法为\(x\cdot\begin{bmatrix} 0 \\\\1 \end{bmatrix}+y\cdot \begin{bmatrix} -1 \\\\0 \end{bmatrix}\)

也就相当于\(\begin{bmatrix} 0 &-1\\\\1&0 \end{bmatrix}\cdot \begin{bmatrix} x \\\\y \end{bmatrix}\)

这里的\(\begin{bmatrix} 0 &-1\\\\1&0 \end{bmatrix}\)是相当于在我们的基底的环境下,需要转换的基底的表示方法。

假设A是我们基底下,他人基底的表示方法

$A\cdot $他的向量(原本以x轴正方向,y轴正方向的x,y向量)=我的向量(新基底的向量)

\(\Rightarrow A^{-1}\cdot A\cdot\) 他的向量=$A^{-1}\cdot $我的向量

$\Rightarrow $ 他的向量=$A^{-1}\cdot $我的向量

这里的他的,我的表示不同基底的表示,但是本质是同一个向量

\(A^{-1}\cdot M\cdot A\) 表示一种数学上的转移作用,中间矩阵代表一种你所见到的变换,而两侧的矩阵代表视觉的转移。

10.特征向量与特征值

特征向量

对于一个特定的矩阵\(A\)(线性变换)

- 特征向量:被拉伸/压缩方向不变的向量

- 特征值:特征向量在 拉伸/压缩 的比例

计算思想 \(A\vec v=\lambda\vec v\)

\(A\):线性变换

\(\vec v\):特征向量

\(\lambda\):特征值

原式:\(\Rightarrow (A-\lambda I)\vec v=\vec 0\)

相当空间压缩,秩不为满时才存在特征向量与\((A-\lambda I)\)相乘为\(\vec 0\)

我们只需要求 \(det(A-\lambda I)=0\) 计算出 \(\lambda\),带回方程$ (A-\lambda I)\vec v=\vec 0$然后算出特征向量。

特征基(以特征向量为基)

对角矩阵:除了对角元意外其他元素都为零的矩阵,这个矩阵有利于计算幂次。

当我们使用特征向量作为基向量,我们就能让线性变换的矩阵变换为对角矩阵(对角化)。

通过这样我们可以降低高阶幂计算的复杂度。

需要注意的是,不是所有的变换都能找到特征基。

11.抽象空间向量

向量到底是什么?

向量是什么并不重要,只要对象几何有合理的相加,相乘,都是向量。线性代数具有普适性。

只要满足向量加法和数乘的规则,即能使用线性代数。向量可以是任何东西!

写在后面:

在这里再次感谢up婆婆町和3Blue1Brown的辛勤付出

ps:笔者写这篇文章时正值罗小黑2电影上映,我的评价是:值得一看

作为国产动画,制作水平上流,打戏精彩,剧情完整。 诚然罗小黑这个系列遭受到许多争议,但是就这一部电影来说,无疑是精彩的,建议观看!